Béhaviorisme

Amélioré par Martina Salemma

Introduction

Le béhaviorisme (ou comportementalisme) définit l’apprentissage comme une modification durable du comportement résultant de la conséquence d’un entraînement particulier. Le terme « béhavioriste » fut utilisé pour la première fois par John B. Watson en 1913 dans un article portant sur la nécessité d’observer les comportements pour pouvoir les étudier.

Plus tard, B.F. Skinner développa le concept de conditionnement opérant (initié au départ par Edward Thorndike, 1913) qu’il distingue du conditionnement pavlovien ou classique (Pavlov, 1901).

Principes guidant le courant béhavioriste

Des préférences et des aversions naturelles guident l’apprentissage. Trois principes généraux de l'apprentissage :

- L’expérience forme le comportement (il y a des comportements innés, mais la plupart des réactions des êtres humains sont acquises).

- L’apprentissage est adaptatif (l'environnement n'étant pas stable, la nature élimine les organismes non-adaptés. L'apprentissage est en outre réversible en fonction de l'environnement).

- Il est possible de découvrir les lois d’apprentissage grâce à des expériences systématiques (aussi bien pour les animaux que pour les êtres humains).

N.B. Aristote (ca. 400 av. J.C.) a déjà proposé des lois d’association expliquant les conditions sous lesquelles une pensée peut se connecter avec une autre (contiguïté et similarité).

Vision globale du béhaviorisme

La carte conceptuelle ci-dessous présente une vue globale du béhaviorisme, et des conditionnements classique et opérant qui sont définis dans les section suivantes.

Cette carte conceptuelle est expliquée dans cette vidéo (par Félicie).

Le conditionnement classique

Ivan Pavlov (1898)

Ivan Pavlov est le père du mouvement béhavioriste, grâce à ses expériences sur les chiens dont la salivation n'est pas exclusivement causée par la présence de nourriture, mais également par un bruit annonçant l'arrivée de la nourriture (pour autant que celui-ci ait été associé à la nourriture au préalable). Ce type de comportement est aujourd'hui connu sous le nom de « conditionnement classique ».

Concepts-clés du conditionnement classique

Pavlov (1898) a étudié les réflexes tels que la salivation au cours de ses recherches dans le domaine de la physiologie de la digestion. Trois concepts-clés se dégagent de ses études :

- Un réflexe est un comportement déclenché automatiquement par un stimulus environnemental et qui se manifeste sans contrôle volontaire (tel que le réflexe rotulien ou myotatique, le clignement des yeux, le réflexe de préhension).

- Un stimulus est un élément de l’environnement qui provoque une réaction.

- Une réaction est une réponse comportementale à un stimulus.

L'observation de Pavlov

Le tintement d’une cloche est produit à chaque fois que le chien va être nourri et provoque la salivation – la même réaction que la nourriture.

Le chien a ainsi été « conditionné » pour réagir au son de la cloche. Le chien a appris à associer la cloche à la nourriture.

En termes de théorie de l’apprentissage, un nouveau stimulus – la cloche – peut provoquer une réaction – le réflexe de salivation. Le principe du conditionnement classique est donc la substitution d’un stimulus (la nourriture) par un autre (la cloche). Pour une simulation, voir le lien suivant: [2]

Le processus : acquisition d’une réponse de conditionnement classique

Le stimulus conditionnel ne provoque pas immédiatement une réponse. Dans le cas des chiens de Pavlov, c'est après trois répétitions que le stimulus conditionnel (un son de cloche ou une lumière) provoque une réponse conditionnelle (la salivation). Cette réponse conditionnelle est stabilisée après quatre à six répétitions.

Stimulus inconditionnel (S.I.) = naturel. Peut activer un réflexe sans apprentissage.

- Ex : la nourriture

La réponse inconditionnelle (R.I.) est un réflexe qui se produit naturellement et sans apprentissage.

- Ex : la salivation

Stimulus neutre (S.N.). Stimulus qui n’entraîne pas de réflexe de manière naturelle

- Ex : un son de cloche

Un stimulus conditionnel (S.C.) est un stimulus qui peut provoquer une réaction suite à un apprentissage.

- Ex : le son de cloche après l'association nourriture-son par présentation simultanée.

Une réponse conditionnelle (R.C.) est la réaction apprise – manifestation du réflexe suite à la présentation d’un stimulus conditionnel.

- Ex : La salivation qui survient lorsque le chien entend le son de la cloche, après apprentissage.

Ainsi, le conditionnement classique (ou conditionnement pavlovien) est la forme d'association d'un stimulus neutre avec une réponse inconditionnelle. Il y a donc substitution du stimulus inconditionnel par le stimulus neutre.

Résumé du processus de conditionnement classique

La carte conceptuelle ci-dessous, reprise et expliquée dans cette vidéo (par Marc Metziger), résume les 3 étapes permettant de lier un stimulus neutre à une réponse auparavant inconditionnelle, par un conditionnement classique, ainsi que 5 expériences-clés ayant permit de tester le conditionnement classique.

Aversions gustatives conditionnées

Les êtres humains peuvent également être conditionnés selon les principes du conditionnement classique, comme dans le cas d'une aversion gustative. L’aversion est conditionnée en associant un goût (S.N.) à une expérience déplaisante, généralement la nausée (R.I.). C'est un conditionnement très rapide : deux présentations de la nourriture appariées à la nausée suffisent[2].

La plupart du temps, le développement d'une aversion gustative conditionnée est adaptatif. Les personnes qui développent une aversion apprennent ainsi à éviter d'ingérer des nourritures toxiques, ce qui facilite l’adaptation dans un environnement complexe.

L’apprentissage des aversions gustatives fonctionne aussi sans intervention de la conscience[3]:

- Les rats ayant subi une ablation du cortex et les animaux complètement anesthésiés peuvent encore apprendre des aversions gustatives induites par des nausées.

Réactions émotionnelles apprises

Une réaction émotionnelle conditionnée est le résultat d’une substitution d’un stimulus qui naturellement provoque une réaction émotionnelle par un stimulus neutre. Ceci peut expliquer le développement de troubles émotionnels tels que les phobies.

Ci-dessous deux exemples:

Le conditionnement de la peur chez le rat

- un rat est placé dans une boîte avec un sol grillagé (des chocs électriques peuvent être envoyés à la grille).

- en premier lieu, on fait retentir un son seul, le rat se retourne.

- ensuite on associe le son au choc électrique.

- finalement, le rat réagit au son (le rat a peur) bien qu'il n'y ait plus de choc électrique.

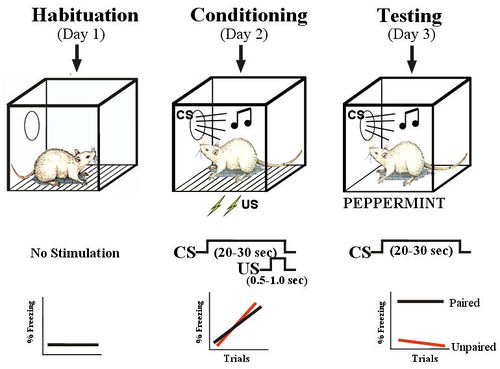

Fear Conditioning. Fear conditioning occurs in three phases.

1. In habituation the rat is acclimated to the chamber. No stimuli are presented.

2. During conditioning the tone conditioned stimulus (CS) is paired with the footshock unconditioned stimulus (US).

3. Testing then involves presentation of the CS without the US the next day.

Typically, the rat exhibits freeing responses to the CS during the test. If the rats received unpaired presentations of the CS and US during conditioning, they freeze little to the CS, indicating that they did not come to associate the CS with the US.[4]

Le conditionnement de la peur chez l'humain: L'expérience du Petit Albert[5]

Voir la Vidéo Youtube de l'expérience du petit Albert. Il faut préciser que l'expérience menée sur le petit Albert a été faite à une époque où les règles éthiques concernant les expériences psychologiques sur les êtres humains n'étaient pas encore clairement définies.

- S.N.: avant le conditionnement Albert joue avec des objets velus tels qu’un rat, un lapin, un masque de Père Noël.

- S.I.: faire retentir une barre métallique directement derrière sa tête en présence des S.N.

- R.I.: Albert saute, tombe et pleure.

- Conditionnement: association d’un rat (S.N.) avec un stimulus aversif – un fort bruit (S.I.): chaque fois qu'Albert tente d’approcher le rat, les chercheurs font retentir la barre métallique.

- R.C.: après sept associations, Albert pleure en présence du rat.

- La même réaction s’observe en présence d’autres objets velus (manteau de fourrure blanc, chat blanc) cinq jours après le conditionnement et encore 26 jours plus tard (généralisation).

Le conditionnement opérant

La contribution théorique majeure de B.F. Skinner (1904-1990) à la psychologie est le concept de conditionnement opérant, qu'il distingue du conditionnement classique pavlovien ou classique. Une classe de comportement constitue un opérant si la probabilité d'apparition de ces réponses est modulable par la manipulation des contingences de renforcement. En clair, on dira qu'une action est conditionnée de manière opérante quand sa fréquence augmente dans le comportement d'un organisme du fait de ses conséquences positives pour l'organisme. Ainsi, si dans le conditionnement classique un stimulus entraîne une réponse, dans le conditionnement opérant, on renforce une réponse par la manipulation des contingences.

L’étude de Edward Thorndike (1898)

Avant de comprendre le conditionnement opérant, il faut faire un détour par les expériences réalisées par Thorndike (1998) :

- Un chat se trouve dans une cage munie d’un levier mécanique (la « puzzle box ») ; à l’extérieur, de la nourriture est placée bien en vue.

- Le chat explore la cage. Par hasard, il trébuche sur le levier, la porte de la cage s’ouvre et le chat accède à la nourriture.

Que se passe-t-il si le chat est remis dans la cage ? Le chat manipule de plus en plus efficacement le levier et quitte la cage dès que la nourriture est présentée. Voir une des nombreuses vidéos que l'on peut trouver sur Youtube à ce sujet.

Conditionnement instrumental et courbe d'apprentissage

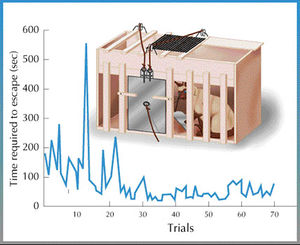

La courbe d'apprentissage (voir figure 2) :

- D'abord, le chat met un certain temps avant de réussir à sortir de la boîte. Néanmoins, il réussit à activer le mécanisme de façon aléatoire.

- Par la suite, le temps qu'il met pour sortir diminue.

- Puis, typiquement, il y a un ralentissement de la vitesse d'apprentissage.

- Enfin, le temps que le chat met pour sortir se stabilise.

Ainsi, la courbe d'apprentissage prend approximativement la forme d'une décroissance exponentielle. Après quatre à cinq essais, il y a une stabilisation du comportement. Ce n'est pas un comportement naturel, mais une adaptation.

La « loi de l’effet »

Sur la base de ses observations, Thorndike (1911) a proposé une importante loi de l’apprentissage : la "loi de l’effet". La loi de l’effet est la tendance d’un animal à reproduire un comportement en conséquence des effets de ce comportement sur l’environnement et de l’impact de ses effets sur l’animal - le comportement est donc une fonction de ses conséquences.

La tendance d’un animal à reproduire un comportement dépend des effets de ce comportement sur l’environnement et de l’impact de ses effets sur l’animal - la reproduction d'un comportement est donc encore une fois une fonction de ses conséquences.

- Thorndike a nommé ce processus d'apprentissage le "conditionnement instrumental" parce que le comportement avait un caractère instrumental dans l’accomplissement d’un but – la satisfaction (p.ex. obtenir de la nourriture).

B.F. Skinner (1938, 1953): le conditionnement opérant

Sur la base de ses nombreuses expériences (surtout avec des pigeons et des rats), Skinner a systématisé la façon dont le comportement est contrôlé par l’environnement selon la « loi de l’effet ». Sa position béhavioriste est radicale : c'est une explication du comportement sans utilisation de concepts mentaux.

Les attentes, les sentiments ne sont pas pris en compte dans sa théorie. Il a en outre changé la terminologie de Thorndike de "conditionnement instrumental" en "conditionnement opérant".

Selon lui, tout peut s'expliquer avec ce qui peut être observé dans le comportement.

Les opérants sont des comportements émis (produits spontanément) plutôt que générés par l’environnement.

Trois suppositions fondamentales

- Les animaux sont très fréquemment actifs – ainsi, les organismes manifestent des comportements d’une manière continue.

- Les conséquences des comportements influencent la probabilité de voir ces comportements se répéter à l’avenir.

- L’état motivationnel de l’organisme et son environnement physique et social influencent l’efficacité des conséquences du comportement.

- Ainsi, l’efficacité liée au fait de donner de la nourriture comme récompense pour augmenter la probabilité d'apparition d’un comportement dépend de la durée de la privation de nourriture. Si l'état d'un organisme ne pousse pas celui-ci à produire un comportement, il n'y aura pas d'apprentissage (par exemple, si le chat n'avait pas faim avant d'être placé dans la boite, la nourriture présentée en dehors de la cage n'aurait pas augmenté la probabilité de faire apparaître un comportement visant à sortir de la cage pour manger.)

Renforcement et punition

L'apprentissage skinnerien repose sur deux éléments, le renforcement et la punition, pouvant chacun être soit positif soit négatif. Ces termes doivent être compris dans le sens précis du conditionnement opérant :

- Renforcement : conséquence d'un comportement qui rend plus probable que le comportement soit répété.

- Punition : conséquence d'un comportement qui rend moins probable que le comportement soit répété.

Un renforcement ou une punition peuvent être soit :

- Positif : par l'ajout d'un stimulus agissant sur l'organisme.

- Négatif : par le retrait d'un stimulus agissant sur l'organisme.

Les renforçateurs

Un renforçateur est une conséquence environnementale qui se produit après la réaction d'un organisme et qui rend la réapparition de cette réponse plus probable. Il existe 2 sortes de renforçateurs (éléments de renforcement) :

- Renforçateur primaire : le renforçateur répond directement à un besoin essentiel de l'individu.

- Ex: Nourriture... On peut le comparer au stimulus inconditionnel de Pavlov (même si, dans ce cas, il intervient après le comportement).

- Renforçateur secondaire : le renforçateur dépend d'un apprentissage réalisé au préalable.

- Ex: jouet, argent...

Ainsi, il existe 4 types de conditionnement opérant :

- Renforcement positif : procédure par laquelle la probabilité de fréquence d'apparition d'un comportement tend à augmenter suite à l'ajout d'un stimulus appétitif contingent à la réponse.

- Ex: ajout d'une récompense, félicitations...

- Ex: Dans l'étude de Thorndike (1898), la nourriture est le renforçateur qui pousse à appuyer sur le levier. (Skinner a répliqué l'étude avec des pigeons dans une « Skinner box »).

- Renforcement négatif : procédure par laquelle la probabilité de fréquence d'apparition d'un comportement tend à augmenter suite au retrait d'un stimulus aversif contingent à la réponse. (retrait d'une obligation, d'une douleur...)

- L’apprentissage d’échappement est un renforcement par élimination d’un événement aversif déjà existant: si l'on enlève un stimulus désagréable, le comportement s'en trouve renforcé.

- Ex: Un rat apprend à appuyer sur un levier pour interrompre une stimulation douloureuse telle qu'un choc électrique ou du bruit.

- Ex: Un enfant apprend à ranger sa chambre pour ne plus entendre ses parents se plaindre.

- L’apprentissage d’évitement est un renforcement par élimination d’un événement qui est signalé par avance.

- Ex: Un rat apprend à appuyer sur un levier si un son signale qu’un choc électrique va suivre.

- Ex.: Un enfant apprend à ranger sa chambre avant d’entendre ses parents se plaindre.

- L’apprentissage d’échappement est un renforcement par élimination d’un événement aversif déjà existant: si l'on enlève un stimulus désagréable, le comportement s'en trouve renforcé.

- Punition positive : procédure par laquelle la probabilité de fréquence d'apparition d'un comportement tend à diminuer suite à l'ajout d'un stimulus aversif ou conséquence aversive contingente au comportement cible (ajout d'une obligation, d'une douleur...).

- Ex: Le choc électrique. Un rat produit un comportement (qu'il a soit appris, soit de façon aléatoire), et subit une conséquence douloureuse (un stimulus aversif (dissuasif) est présenté). -> Le rat évite ensuite d’appuyer sur un levier après avoir reçu un choc électrique.

- Ex: Un enfant ne fait plus de désordre dans sa chambre après avoir entendu ses parents se plaindre.

- Punition négative : procédure par laquelle la probabilité de fréquence d'apparition d'un comportement tend à diminuer suite au retrait d'un stimulus agréable ou appétitif (retrait d'un privilège, d'un droit...).

- Ex: On peut imaginer un employé qui n’obtient pas d’augmentation de salaire à cause de ses fréquents retards.

Schéma du conditionnement opérant

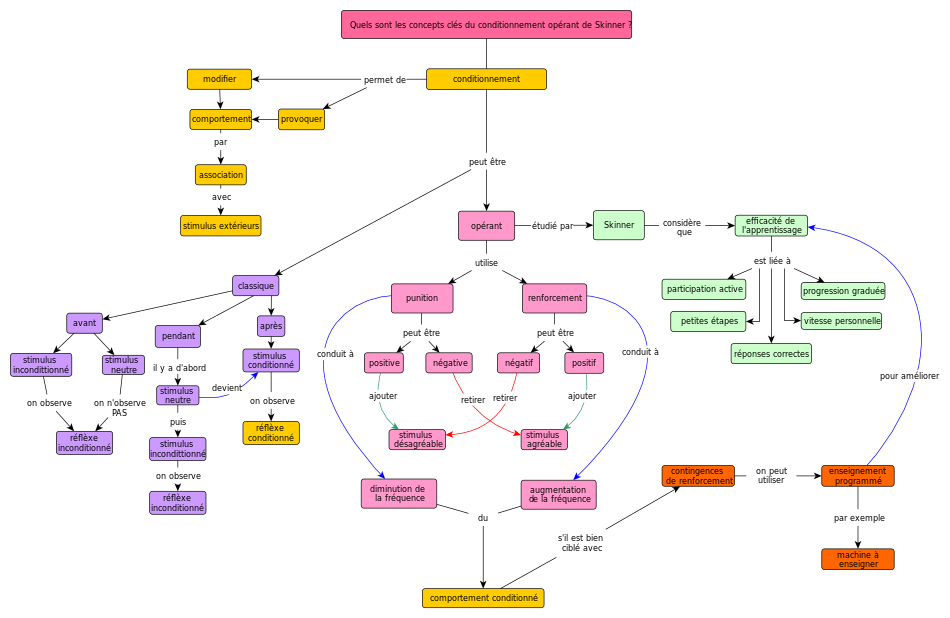

Concepts-clés du conditionnement opérant

La carte conceptuelle qui suit présente les concepts-clés du conditionnement opérant de Skinner, ainsi que la vision de l'apprentissage selon cet auteur. La carte conceptuelle revient également rapidement sur le conditionnement classique, permettant ainsi de le distinguer du conditionnement opérant.

Cette carte conceptuelle est expliquée dans cette vidéo(par Brigitte Steiner).

Problèmes du renforcement et de la punition

Afin qu'un conditionnement opérant soit efficace, l’organisme conditionné doit savoir exactement quel comportement est renforcé ou puni. Il faut connaître des « contingences ».

Ainsi, un des problèmes de la punition est la difficulté à distinguer quel opérant a été puni.

- Exemple : il peut arriver que certains individus appellent plusieurs fois de suite leur chien (ou un enfant) puis lui crient dessus parce qu’il n’est pas venu tout de suite. Dans ce cas, ils punissent le bon comportement : venir après l’appel.

La littérature montre que sur le long terme, l’extinction est plus efficace que la punition positive[6]. En effet, après une punition positive, il y a fréquemment une récupération spontanée du comportement non-désiré. Au contraire, un comportement non renforcé a souvent tendance à s'éteindre spontanément, après un certain temps.

Ainsi, pour apprendre à un chien à venir lorsqu'on l'appelle, il est préférable de lui donner de la nourriture (le renforçateur) seulement s'il vient (même si cela prend du temps). Il ne faut jamais aller vers lui, parce que cela renforcera son comportement de non-réaction. Il faut donc définir précisément le comportement que l'on veut renforcer. Cela signifie que, même si le chien met du temps à venir (si c'est le comportement que l'on veut renforcer), il faut lui donner sa récompense (ce qui renforcera son comportement).

L’équipement de recherche: la fameuse « Skinner box »

Skinner a développé la « Skinner box », qui est une boîte avec un fond métallique permettant d'envoyer des secousses électriques.

La « boîte de Skinner » est utilisée sans intervention de l'expérimentateur. Il faut juste définir la réaction voulue pour une cause donnée. Un pigeon ou un rat peut être placé dans une de ces boîtes et un renforcement est donné lorsque l'animal appuie sur un levier (en général, de la nourriture).

vidéo de l'expérience de skinner pour téléchargement

L’étude de Estes (1944): la punition et l’extinction

Estes a comparé l'efficacité de la punition contre l'extinction. D’abord, des rats sont renforcés avec de la nourriture lorsqu'ils appuient sur un levier. Puis, on forme deux groupes (on ne veut plus que le rat appuie sur le levier):

- Punition : au cours d’une session, des chocs électriques sont délivrés lorsque les rats appuient sur le levier.

- Extinction : au cours d’une session, il n’y a plus de renforcement (il n'y a plus de nourriture). Puis on observe les rats pendant quatre jours.

- Mesure: fréquence avec laquelle les rats appuient sur le levier.

- Résultat : la punition réduit le comportement cible (appuyer sur le levier), néanmoins il y a une récupération spontanée.

Après quatre jours, on arrive au même résultat avec les deux méthodes. La punition est efficace mais il faut toujours être en mesure de punir. À court terme la punition marche, mais avec un coût élevé. Elle ne fonctionne pas mieux à long terme. La punition ne peut pas effacer un comportement.

Renforcement et punition en bref

| Renforcement | Punition | |

|---|---|---|

| Positif | Présentation d'un stimulus « agréable » | Présentation d'un stimulus « aversif » |

| Négatif | Élimination d'un stimulus « aversif » | Élimination d'un stimulus « agréable » |

Rappel: les termes « agréable » et « aversif » dépassent les concepts utilisés selon la perspective du behaviorisme classique.

Un regard plus détaillé

| Type | Definition | Effect | Example |

|---|---|---|---|

| Positive reinforcement | Delivery of a pleasant or appetitive stimulus following a behavioral response | Increase the frequency of the behavioral response | If studying is followed by a high grade on an exam, then the incidence of studying before exams will increase |

| Negative reinforcement | Removal of an unpleasant or aversive simulus following a behavioral response | Increase the frequency of the behavioral response | If leaving a study area removes you from a noisy classmate, then the time you spend away from the study area will increase |

| Positive punishment ("punishment") | Delivery of an unpleasant or aversive stimulus following a behavioral response | Decrease the frequency of the behavioral response | If your professor embarrasses you for asking a question in class, then the likelihood you will ask questions in class will decrease |

| Negative punishment ("omission training") | Removal of a pleasant or appetitive stimulus following a behavioral response | Decrease the frequency of the behavioral response | If your girl- or boyfriend withholds affection whenever you watch TV, the time you spend in front of the TV will decrease. |

Comment peut-on changer une réaction conditionnée ?

Il existe au moins trois stratégies pour changer ou éliminer des réactions conditionnées :

- L'extinction : ne rien faire, mais cela demande beaucoup de patience (par exemple : ignorer le mauvais comportement d'un enfant).

- La punition : présenter une conséquence dissuasive ou éliminer une conséquence agréable du comportement.

- Le contre-conditionnement : renforcer un comportement incompatible (par exemple : féliciter un enfant d’être assis afin d’éliminer son habitude de courir partout).

Et l’être humain ?

La théorie du conditionnement opérant de Skinner nous permet d'établir un lien direct entre béhaviorisme et pédagogie. Les autres théoriciens (Pavlov, Watson) s'étaient intéressés jusque-là aux mécanismes d'apprentissage, tant pour les humains que pour les animaux, mais n'en avaient pas tiré d'application concrète à destination de l'enseignement. Skinner, tirera des applications pédagogiques de ses théories. Pour lui, l’efficacité de l’apprentissage est liée à cinq principes :

- le principe de la participation active : le sujet doit construire sa réponse et non la choisir ;

- le principe des petites étapes : il faut fragmenter la difficulté pour que même les plus faibles puissent répondre ;

- le principe de progression graduée ;

- le principe de l’allure personnelle : chacun doit pouvoir avancer à son rythme ;

- le principe des réponses correctes : trop d’échecs découragent les élèves, il faut les guider.

L’enseignement programmé

Skinner critique l’enseignement classique. Ses travaux en psychologie du comportement soulèvent l’importance d’un renforcement pour l’apprentissage. Pour lui, ce renforcement est fondamental et doit être immédiat, or, dans les classes habituelles, le délai serait trop long. De plus, pour lui, le renforcement ne s’intègre pas dans une suite logique d’activités qui permettrait à l’élève d’apprendre un comportement complexe. Enfin, les renforcements sont trop rares, ceci étant lié essentiellement au fait que de nombreux élèves dépendent d’un même enseignant.

La machine à enseigner

Il propose donc de réformer cette école, en partant des résultats du conditionnement opérant, en tant que théorie du contrôle des mécanismes d'apprentissage. Il envisage ainsi la création d'une technologie scientifique de l'enseignement qui utilise l'enseignement programmé, susceptible d'être dispensé par une machine à enseigner. La machine à enseigner de Skinner est une boîte parallélépipédique dans laquelle se trouve un rouleau de papier. L’élève commande le déroulement de la bande par la molette se trouvant sur le devant. Les questions apparaissent ainsi une par une ouverture dans la fenêtre. L’élève inscrit sa réponse sur un espace blanc réservé à cet effet, puis tourne la molette. Ceci lui permet de voir la réponse. Il compare ainsi son résultat à la réponse fournie et, si elle est juste, il actionne un levier qui, par perforation de la feuille de programmation, enregistre les bonnes réponses. Puis, il passe à la question suivante.

Dans la machine de Skinner, l’enseignement est apporté par la correction immédiate. Mais il s’agit avant tout de machines d’auto-évaluation et non de support de connaissances au sens où nous l’entendons habituellement. La machine propose en outre un enseignement linéaire, en aucun cas la réponse de l’élève ne peut influencer le choix de la question suivante. Pour Skinner (1968), « l’élève doit composer lui-même sa réponse, plutôt que de la choisir parmi plusieurs possibilités, comme c’est le cas dans les dispositifs à choix multiples ». En effet, il pense que le Q.C.M entraîne des erreurs que l’élève n’aurait jamais commises sans cette suggestion. De plus, dans la machine de Skinner c’est l’élève qui s’auto-corrige en comparant sa réponse à celle du programme. Enfin, dans ces machines, bien que Skinner prône le renforcement, il juge qu’un renforcement extérieur n’est pas nécessaire car les renforcements intrinsèques de la réussite et du progrès sont suffisants et inépuisables.

Vidéo sur la machine à apprendre

Un cas exceptionnel : l'empreinte

- L’empreinte est la seule forme d’apprentissage qui est irréversible.

- Elle est basée sur un instinct et se passe seulement dans une certaine fenêtre temporelle.

- Sa fonction est la fixation sur un objet dans l’environnement comme guide pour la survie.

-

Figure 2.

-

Figure 3.

Figures 2 & 3. ULM accompagnant des oies et des grues « imprimées »[7].

Exemple: l'empreinte des canards

- Pour les canards, l’empreinte se passe entre 11 et 18 heures après la naissance. Plus tard, l’empreinte n’est plus possible à cause du développement de la peur[8]. En effet, après 18 heures, les canetons développent une aversion pour la nouveauté et ne peuvent donc plus être "imprimés".

-

Figure 4. À travers l'empreinte, un caneton nouveau-né apprend à suivre le modèle de canard dans le circuit circulaire.

-

Figure 5. La figure ci-dessus montre à quel âge (en heures) le caneton apprend à suivre l'objet (qui est supposé représenter sa mère). Après cette période-là, le petit développe la peur et l'apprentissage (l'empreinte) disparaît.

Pour aller plus loin

Pour des raisons de droits d'auteur, nous ne pouvons pas vous donner directement accès aux articles et chapitres de livres ci-dessous. Certains d'entre eux, en particulier les articles de revues, requièrent soit d'être connecté sur le réseau de l'unige, soit d'installer le VPN qui vous permet d'accéder au réseau de l'unige depuis votre machine. D'autres sont directement accessibles sans passer par le réseau de l'unige.

- Skinner, B. F., Teaching machines., Science, Vol 128, 1958, 969-977. doi: 10.1126/science.128.3330.969

- Watson, John B.; Rayner, Rosalie., Conditioned emotional reactions, Journal of Experimental Psychology, Vol 3(1), Feb 1920, 1-14. doi: 10.1037/h0069608

Notes & Références

Crahay,M. (1999).Psychologie de l'éducation. Paris : PUF

O’Shea, T. & Self, J. (1983). Learning and Teaching with Computers - Artificial Intelligence in Education. Brighton: Harvester Press.

Pavlov, I.P. (1901). Le travail des glandes digestives. Paris Masson et Cie.

Skinner, B.F. (1971). L’analyse expérimentale du comportement, un essai théorique. Bruxelles, C. Dessart.

Thorndike, E. (1913). Educational Psychology: The Psychology of Learning. New York: Teachers College Press.

Watson, J.B. (1913). Psychology as the behaviorist views it. Psychological Review, 20, pp. 158-177.

Droits d'auteur

- Les textes sont disponibles sous licence Creative Commons, paternité partage à l’identique 3.0, non transcrit (CC-BY-SA 3.0)

- Une partie de cet article est une synthèse d'articles provenant de Wikipédia. Articles originaux:

- http://fr.wikipedia.org/wiki/B%C3%A9haviorisme

- http://fr.wikipedia.org/wiki/Conditionnement_classique

- http://fr.wikipedia.org/wiki/John_Broadus_Watson

- http://fr.wikipedia.org/wiki/Conditionnement_op%C3%A9rant

- http://fr.wikipedia.org/wiki/Burrhus_Frederic_Skinner

- http://fr.wikipedia.org/wiki/Edward_Thorndike

- Une partie de cet article est une synthèses d'articles disponibles sur http://deliriumstudens.org/wiki/index.php

- Une partie de cet article a été créée par les auteurs de cette page

Créer une nouvelle sous-page production vidéographie

Ajouter une nouvelle production (MAX par promotion = 2)

Sous-pages qui existent déjà et (y compris des productions):

- Béhaviorisme/Behaviorisme, les facteurs affectant le conditionnement classique

- Béhaviorisme/Béhaviorisme conditionnement

- Béhaviorisme/Concepts clés du conditionnement opérant

- Béhaviorisme/L'acquis d'un apprentissage selon le béhaviorisme

- Béhaviorisme/Qu'est ce que le béhaviorisme et le conditionnement?

- Béhaviorisme/Une vision globale

- Béhaviorisme/conditionnement opérant de Skinner

- Béhaviorisme/l'apprentissage par essai et erreur d'Edward Lee Thorndike