Lexos

| Analytique et exploration de données | |

|---|---|

| Module: Outils text mining | |

| ⚐ à améliorer | ☸ débutant |

| ⚒ 2015/08/31 | ⚒⚒ 2014/11/19 |

| Catégorie: Outils text mining | |

Description

Lexomics est une méthode d'analyse stylistique, parfois appelée stylométrie. Ce type d'analyse exploite la puissance de l'informatique moderne et des techniques statistiques pour investiguer sur le contenu des textes.

Le rôle de Lexos est d'aider les utilisateurs à identifier et explorer le différentes modèles existant dans les textes, ouvrant ainsi de nouvelles questions et de nouvelles voies de recherche. Lexos fournit un workflow intégré d'outils de pré-traitement, d'analyse et de visualisation qui permettent aux étudiants et chercheurs de détecter et d'explorer des modèles dans leurs textes. Lexos est librement disponible pour une utilisation en ligne, et il peut également être téléchargé et installé localement pour de meilleures performances.

Lexos a été créée pour une utilisation avec les petites collections de textes (plutôt que de grands corpus de texte ou "Big Data"), et pour une utilisation avec les langues qui ont des systèmes d'orthographe latines.

Lexos est un outil très rigoureux et puissant qui permet d'explorer plus l'impact que les approches quantitatives et algorithmiques ont sur les sciences humaines.

Exemple d'utilisation

Dans le cadre d'une recherche on s'interesse à l'utilisation des dispositifs numériques pour l’enseignement-apprentissage du solfège à l'école primaire. On possède que un texte de base et on a l'objectif de trouver d'autres recherches/articles scientifiques qui traitent de la même problématique. Pour ce faire on a mené une recherche en google scholar en utilisant comme critère de recherche les mots clé: musique, technologie, dispositif numérique, didactique. L'objectif de la recherche est, tout d'abord, un objectif exploratoire. Plus en particulier le but est celui de comprendre si ces articles pourraient être utilisables dans cette recherche et donc si le contenu est similaire à celui du texte de base.

Pour se faire on utilise le logiciel open source Lexos, les 5 textes sélectionnés au préalable sur google scholar et le texte de base.

Procédure

Téléchargement des 6 textes

Choix de l'analyse: Analyze --> Similarity Query

Cette choix correspond au mieux à l'objectif exploratoire car elle permet de comparer un texte de base à d'autres textes.

Sélectionnez le texte qui va être utilisé en tant que texte de base

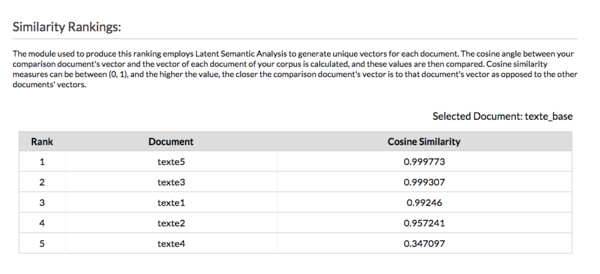

Tableau des résultas qui montre la similarité entre le texte de base et les autres

Un catégorisation est faite en ordre décroisante à partir de celui qui est plus similaires au niveau du contenu au texte de base. Le résultat de similarité peut varier de 0 à 1, où 1 correspond à une similarité parfaite. Grace à cette première analyse on peut observer que les textes à prendre en compte son plutôt les premier 4 alors que le dernier (texte 4) est le moins similaire. Pour les analyses suivantes les textes qu'on utilisera seront ceux les plus similaires à celui de base (1-2-3-5). Etant donné que le texte 4 ne corrèle pas fortement avec celui de base.

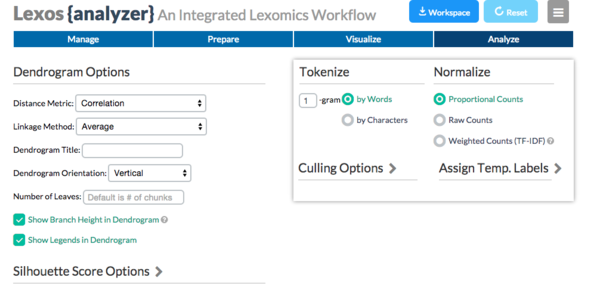

Choix de l'analyze: Analyze --> Clustering --> Hierarchical clustering

Une analyse hiérarchique (ou analyse de cluster) permet de regrouper les termes qui on le plus forte taux de similitude entre eux et au même temps de accentuer les différences. Elle forme des classes de stimuli. Pour créer une analyse hiérarchique il faut choisir les indices de similitude et une méthode de classification: dans notre cas on va utiliser comme indice de similitude l'indice euclidienne et comme méthode de classification la méthode "Average" (basée sur la moyenne). Chaque indice et méthode de classification est à choisir à dépendance des données à analyser.

Le dendogramme permet de voir deux choses: les classes crées ainsi que l'intensité des liens entre les éléments. L'axe horizontal montre le degré de similitude/association, alors que celui vertical montre les éléments qui ont été utilisés pour l'analyse. Depuis ces résultats on peut voir que le texte 3 est celui plus similaire avec celui de base. Ces deux textes forment une première classe. Ensuite on peut voir que le texte 2 est en lien avec la première classe formée. Au contraire on peut voir que le texte 5 et 1 sont similaires entre eux et que eux aussi forment une classe à part.

Conclusions

Une première conclusion nous amène à retenir deux classes; la première composée par les textes 3, 2 et de base alors que la deuxième composée des textes 1 et 5. Une deuxième conclusion plus générale et pratique, c'est que les articles les plus en lien avec le sujet de recherche choisi sont les texte 2 et 3 plus celui de base.

Avantages et Limites

Avantages

- Logiciels gratuit

- Permet des bonnes analyses

- Interface assez intuitive

Limites

- Les aides à l'intérieur du site (les icônes ?) ne suffisent pas à la compréhension des actions à faire pour l'analyse. Il manque une aide en ligne comme il est, au contraire, très bien fait dans T-Lab

- Il faut avoir des bonnes connaissances préalables sur tout ce qui concerne les analyses statistiques associées au contenu des textes. Il manque un glossaire et manuel d'instruction aux termes statistiques existants comme, au contraire, existe dans T-Lab

- La représentation visuelle des mots est meilleure et ponctuelle dans DocuBurst

Tutoriel

Dans la page officiel des devéloppeurs du logiciels Lexos vous pouvez trouver quelque tutoriel d'introduction à l'utilisation du programme Wheatoncollege