CatchUp

Réalisé par: Bei Cai, Rima Achour Rahmani, Daniel Casas, Laure Geissbuhler

Encadreurs: Gaëlle Molinari et Yannick Nleme

Introduction

CatchUp est le prototype d'un dispositif phygital qui propose de partager la manipulation, les étapes de conception et de fabrication d'un objet tangible avec des personnes à distance dans le cadre d’un travail collaboratif de groupe au FacLAb. Le mot anglais "catch up" signifie rattraper. Un enjeu majeur du travail collaboratif (en présentiel et à distance, synchrone et asychrone) au Faclab est le risque du manque de la continuité. Les collaborateurs à distance ou absents peuvent avoir de la difficulté à bien suivre l'avancement du projet, surtout quand la production des objets tangibles est inclue dans le projet. Donc ce dispositif phygital vise à aider les utilisateurs à rattraper les informations perdues à cause de la distance ou absence afin de maintenir la continuité du travail, ce qui nous a amené à donner le nom CatchUp.

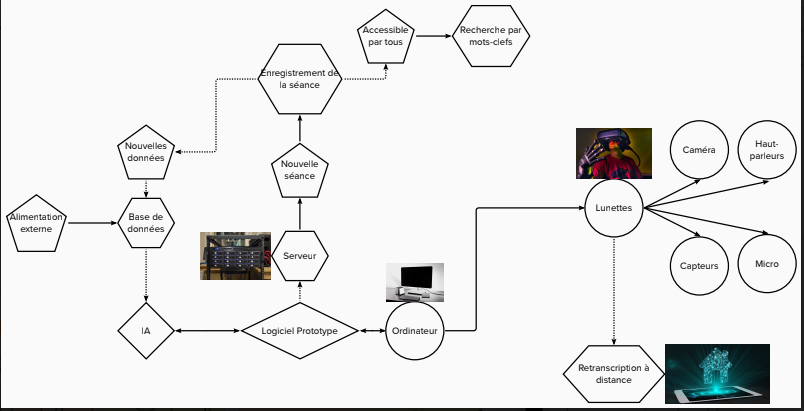

CatchUp est nourri par l’IA, constitué d'un dispositif haptique tactilo-kinesthésique comprenant une paire de lunettes RA, une paire de gants électroniques avec des capteurs intégrés par utlisateur-trice et d'une application couplée à une base de données qui permet la connexion du dispositif haptique visuel et audio, assure la modélisation 3D des objets manipulés, le déroulement de la séance et alimente la base de données. L'application peut être disponible sur smartphones, tablettes et ordinateurs et propose des fonctionnalités qui sont au service des objectifs cibles. Il est destiné principalement au personnel des FacLabs de Genève, mais peut être notamment utilisé par d’autres FacLabs.

CatchUp permet la continuité présence-distance des activités au FacLab, le partage des données en synchrone et asynchrone, la manipulation des objets tangibles en distanciel. Les utilisateurs peuvent ainsi participer à des séances de conception collaboratives, assister à une séance de conception ou revoir la séance en fonction des objectifs individuels ou de groupe grâce aux différentes fonctionnalités proposées dans l’application.

CatchUp collecte et organise les informations multimédias des différents moments clés des processus de collaboration dans les buts de :

- construire et maintenir une représentation et une expérience partagée;

- sélectionner les gestes générant des stratégies efficaces;

- documenter l’historique des progressions et modifications des processus;

- retracer de façon condensée les processus pour les communiquer à d’autres groupes;

- informer la plateforme et son répertoire d’objets;

- alimenter la base de connaissance du FacLab.

Besoins

Demande de la commanditaire

La commanditaire Nathalie Borgognon explique dans sa demande l'intérêt de proposer un outil qui répond aux besoins de la conception collaborative et au partage des expériences dans le FacLab de Genève. Il doit répondre , également, aux problématiques liées aux différentes formes de discontinuité induites par les 3 dimensions d’hybridité du dispositif FacLab :

- présence – distance

- synchrone – asynchrone

- hybride physique – digital

En examinant la situation, nous pouvons reformuler la commande en question-problème suivante: comment partager la manipulation et les étapes de conception et fabrication d'un objet tangible avec des personnes à distance dans le cadre d’un travail collaboratif de groupe au FacLab? Ainsi, le cœur du problème est de comment construire et maintenir une représentation et une expérience partagée. De cette problématique, plusieurs sous-questions sont posées :

- Comment soutenir et relier la compréhension de l’activité des différents partenaires dans ce contexte et garder les objectifs à atteindre (awareness) ?

- Comment communiquer les difficultés de compréhension des différents partenaires et par quel moyen les résoudre ?

- Comment gérer les feedbacks et les incorporer au processus ?

- Comment générer une information qui permette d’expliciter et de créer un socle de connaissance commun et partageable ?

- Comment mieux communiquer aux partenaires à distance les informations (problèmes, modifications etc.) d’un objet tangible?

Les réponses à ces questions consistent en la création du dispositif phygital.

Besoins des utilisateurs

Afin de déterminer les besoins des usagers, nous nous sommes posés, tout d’abord, des questions sur la notoriété de l’outil pour les éventuels utilisateurs à savoir: comment présenter les informations? Que peut-on montrer, par exemple les types des activités; sous quelles formes et à qui les communiquer/partager? La connaissance des partenaires: qui a fait quoi? Quand? Ensuite, sur l’historique des progressions, indicateurs des processus de collaboration, des choix effectués et les diverses stratégies gagnantes qu’il faut adopter. Après cette analyse, nous avons supposé qu’ il y a une équipe qui collabore à la conception et la fabrication d’un artefact tangible (matériel) au sein du FacLab dans une dynamique de co-construction participative, dans un dispositif de travail en présentiel et distanciel synchrone et en asynchrone. À travers ce contexte, nous avons cerné plusieurs besoins auxquels notre outil peut essayer de répondre :

- Concevoir, collaborer, fabriquer, partager et documenter les processus de fabrication et de conception de ses artefacts.

- Se coordonner et de maintenir une cohérence entre ses membres

- Garantir un accès le plus semblable possible à l’expérience et aux manipulations à tous les membres du groupe de travail dans les étapes de conception et de fabrication des artefacts.

- Pouvoir informer/ renseigner, éventuellement enseigner les techniques de fabrication en les montrant par la suite.

Revue de littérature

L’awareness mutuel dans un Environnement virtuel collaboratif

Lorsque plusieurs acteurs interagissent dans le même espace, chacun d’eux génère de son côté un ensemble de signaux qui, une fois perçus par les autres, permettent aux autres acteurs d’avoir une certaine connaissance des actions effectuées et faire des interactions effectives. Cette connaissance des actions est connue sous le terme awareness qui “permet à deux ou plusieurs utilisateurs d’adapter et de planifier leurs comportements en fonction de ce qu’ils savent réciproquement des autres.” (Ouramdane, 2009) Gutwin et Greenberg (Greenberg et al., 1996) relèvent quatre caractéristiques au concept d’awareness :

- L’awareness est la connaissance de l’état d’un environnement délimité dans l’espace et le temps.

- L'awareness est constituée de connaissances qui doivent être mises à jour en fonction des transformations de l’environnement.

- L’awareness est entretenue par l’interaction des personnes avec l’environnement.

- L'awareness est souvent liée à une activité. Elle ne représente pas un but en soi mais elle participe à la résolution d’une tâche.

“Les EVCs sont des environnements virtuels multi-utilisateurs qui permettent à un certain nombre de participants de partager un espace virtuel commun et de réaliser un objectif ensemble”(Ouramdane, 2009). Dans un EVC, si les acteurs peuvent avoir l’awareness, c’est-à-dire percevoir les signaux d’action générés par les autres comme s’ils se trouvent dans un même endroit physique, les interactions collaboratives bénéficieront plus à l’atteinte de l’objectif.

EMMIE (Environement Management for Multi-user Information Environnement)

L’EMMIE développé par Butz et al(1999) est un prototype d’interface utilisateur hybride censé supporter le travail des collaborateurs en leur fournissant un environnement d’information argumenté. Leur objectif est que dans cet environnement, les informations présentées dans l’interface 2D et l’interface 3D RA se complètent et peuvent être facilement déplacées entre les deux interfaces. Donc l’EMMINE introduit un nouveau concept d’interaction hybride entre deux types de représentations 2D et 3D. Par exemple, l’utilisateur peut déplacer des objets virtuels depuis les écrans (représentation 2D) vers un espace virtuel (représentation 3D) défini au-dessus de la table de travail. Les interfaces RA peuvent améliorer un environnement informatique en permettant de visualiser certaines parties cachées. Cependant, comme Butz et al(1999) ont souligné, un inconvénient important des interfaces RA pures est que leurs éléments d'interface sont tirés d'environnements purement virtuels, tels que les widgets 3D, et restent donc dans le domaine virtuel. De telles interfaces peuvent être difficiles à gérer, en partie parce que les affordances offertes par des interfaces plus concrètes sont absentes. Donc ils pensent que les systèmes RA peuvent tirer profit de l'utilisation d'objets physiques et des techniques d'interaction qu'ils fournissent. Par conséquent, en intégrant RA à un environnement informatique, on peut tirer parti des affichages pour permettre aux utilisateurs de manipuler les informations de manière concrète, le cas échéant.

Méthode de conception

Nous nous sommes basées sur une revue de littérature scientifique variée afin de répondre à la demande de la commanditaire et l’équipe enseignante . L’objectif est de cerner les attentes de la commanditaire, les objectifs pédagogiques et l'utilisabilité de notre produit chez les éventuels utilisateurs. Nous pouvons qualifier notre produit d’instrument médiateur entre les collaborateurs en présentiel et à distance en mode synchrone ou asynchrone comme le soulignent Nogry et al.:

” l’approche instrumentale (Rabardel, 1995) est ancrée dans les théories de l’activité : l’homme est entouré d’artefacts et de technologies culturellement constitués qu’il peut mobiliser au cours de son activité afin d’atteindre son objectif (...) Lorsque ces artefacts jouent le rôle de médiateur entre le sujet et l’objet, ils deviennent alors des instruments” (2013, p. 422).

La conception d’EIAH exige le choix entre deux démarches de design technopédagogique: un modèle waterfall (le modèle ADDIE) et un modèle agile (le modèle SAM), alors dans ce dernier modèle, nous inscrivons notre produit et que nous avons personnalisé en fonction de l’objectif, afin de le rendre acceptable, utilisable et utile (Caroll, Howard, Peck, & Murphy, 2003).

Notre perspective de conception repose sur l’idée de croiser les différents savoirs acquis au MALTT pour rendre l’outil le plus efficient possible du point de vue de l’ergonomie à savoir les critères de Bastien et Scapin ( grille de critères Bastien et Scapin, 1993). Nous avons cherché la flexibilité dans le critère d'adaptabilité, notant que pour la même Data, l'utilisateur possède le choix de la revoir dans son intégralité ou la personnaliser en fonction de ses besoins. Cela se fait à travers le contrôle utilisateur (explicite) qui lui permet de faire son propre résumé, choisir les réunions de conception, choisir les notes, les objets et leurs dimensions. D’un autre côté, notre perspective repose sur une approche pédagogique particulièrement numérique: “un EIAH est, fondamentalement, la conjonction d’une intention didactique ou pédagogique et d’un environnement informatique. Concevoir un EIAH, c’est concevoir, organiser et gérer un dispositif impliquant des acteurs humains (au moins un apprenant et éventuellement plusieurs, le cas échéant un ou plusieurs enseignants ou tuteurs) et un ou plusieurs artefacts informatiques.” (Tchounikine, 2002, p. 175).

La création des scénarios, les fonctions proposées pour chaque scénario sont fondées sous l’onglet pédagogique qui assure la continuité de l’apprentissage individuel et encourage le collectif en employant les outils les plus appropriés pour chaque type de situation. Dans leur méta-analyse publiée en 2001, Lou et al.(2017) notent que “depuis les années 1990, Higgins et al. (2012) constatent que le recours à des dispositifs numériques pour un travail en binôme ou en petits groupes est " généralement plus effectif que les usages individuels " (p. 14).

La taxonomie de Cosnefroy(Cosnefroy, L.2010) constitue le cadre théorique sur lequel la création et la conception de l’application et sa modalité de fonctionnement sont appuyées. En revanche, nous avons pris toutes les actions qui ont servi à mettre en évidence les objectifs de la commanditaire et de l'équipe pédagogique.

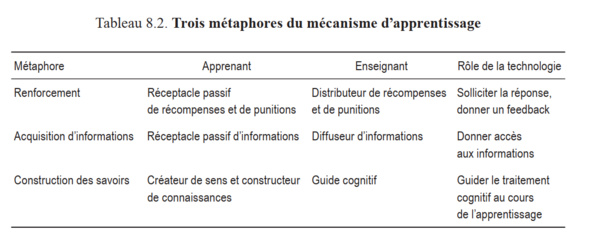

Nous avons aussi eu recours à l'utilisation des métaphores du mécanisme de l’apprentissage pour pouvoir sélectionner, organiser et attribuer à chaque fonction (notes, enregistrement, recherche des mots clés) ainsi que le mécanisme nécessaire pour bénéficier de la séance de conception/ fabrication et atteindre les objectifs fixés. Le tableau suivant résume la démarche suivie:

Afin de peaufiner le choix des outils, nous avons ciblé ceux qui seront au service de l’apprentissage individuel et collaboratif et à en créer d’autres pour favoriser le partage et l'échange à la fois des expériences et des informations. En somme, nous avons essayé de combiner les différents types de messages: audiovisuels, lus et imagés pour privilégier les usages réguliers et fréquents sur une période courte et s’assurer que “l’efficacité des dispositifs numériques pédagogiques [soit] également [...] étudiée au regard de la durée et de l’intensité des usages."(Leroux et al.(2017), pp. 442-443).

Prototype et description

Description générale de l'application

Caractéristiques techniques

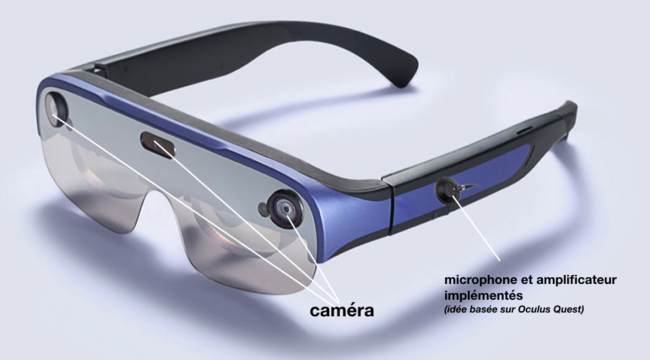

Les aspects et caractéristiques des composants

CatchUp est composé de trois composants qui sont respectivement une paire de lunettes RA, une paire de gants avec les capteurs haptiques intégrés et une application. Les lunettes ont au-dessus des lentilles trois mini-caméras de haute définition qui, lors d’usage, forment une imagerie 3D de l’objet cible. Une fois que les lunettes sont connectées avec l’application et après la formation de l’imagerie 3D, elles vont la transmettre sur l’interface de l’application. Les lunettes ont aussi la fonction d'imager l’objet virtuellement dans l’espace à partir de l’imagerie 3D affichée sur l’écran. En outre, les lunettes possèdent, au niveau des branches, un microphone ainsi qu'un amplificateur, pour écouter les autres participants à distance.

Les gants intègrent des capteurs qui, en touchant un objet, enregistrent les données de la pression et la chaleur ressentie, et transmettent simultanément les données aux autres gants connectés, par l'application.

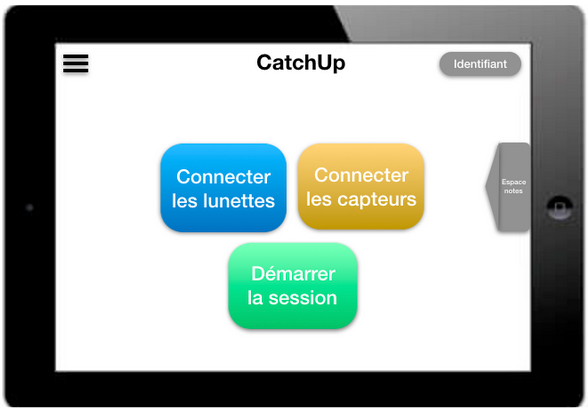

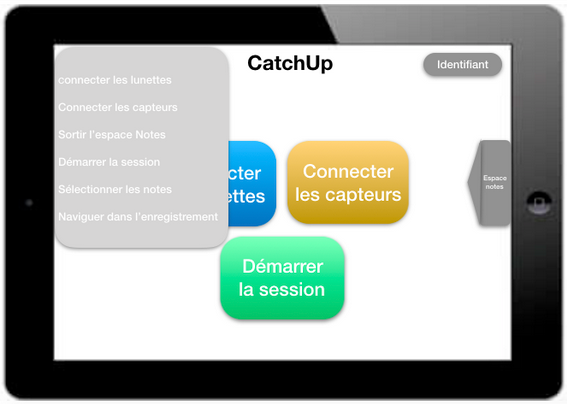

L’application joue le rôle d’un intermédiaire par lequel les lunettes et les gants vont être connectés et l’imagerie 3D va être affichée. Elle possède aussi des fonctions destinées au démarrage de la séance, à l'enregistrement et au traitement des données. Sur l’interface principale de l’application, on peut voir des boutons raccourcis qui permettent de réaliser les fonctions principales : connecter les lunettes ; connecter les capteurs ;, Démarrer la session ; Espace Notes. En haut à gauche de l’interface, on peut trouver l'icône du menu qui contient toutes les fonctions de l’application.

Utilisation de l’outil

À l’aide de la description des trois scénarios concrets et des images des scènes simulées, nous expliquons en détail l’utilisation et les fonctions de l’outil.

Scénario 1

Deux collaborateurs travaillent sur un projet, un en présentiel et l’autre à distance. En utilisant CatchUp, ils vont organiser une séance pour discuter d'un problème lié à l’objet qu’ils sont en train de réaliser. Après l’ouverture de l’application, les collaborateurs se connectent à leurs comptes de CatchUp. Ensuite, en cliquant sur les boutons “Connecter les lunettes” et “Connecter les capteurs”, ils connectent aussi à l’application les lunettes et les gants qu’ils portent sur eux. À travers les lentilles, le collaborateur en présentiel peut voir un point local. En fixant ce point focal sur l’objet cible, les lunettes forment une imagerie 3D de l’objet qui sera immédiatement transmise sur l’interface de l’application. En même temps, les lunettes portées par le collaborateur à distance, en fixant son point focal à l’imagerie 3D affichée sur l’écran, vont imager cet objet virtuellement dans l’espace. Cet objet virtuel est manipulable avec les capteurs des gants. Quand le collaborateur en présentiel touche l’objet réel avec les gants, les capteurs intégrés prennent les données de la pression et la chaleur de la pression et les transmettent à l’application. En même temps, à distance, lors de la manipulation de l’objet virtuel, quand le collaborateur arrive au même point de l’objet que celui en présentiel est en train de toucher, les données de la pression et la chaleur vont être transmises de l’application aux capteurs des gants, c'est-à-dire, les gants permettent au collaborateur à distance de “sentir” physiquement l’objet virtuel vu à travers les lunettes.

Scène collaborateur en présentiel

Scène collaborateur à distance

Scénario 2

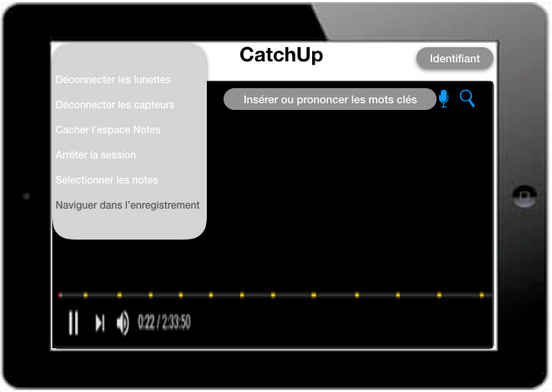

Une collaboratrice a été absente à une séance. Avant la prochaine séance, elle a besoin d'être au courant des points clés de la discussion des autres collaborateurs. Dans ce cas, les fonctions, Enregistrer la séance, Espace notes, Sélectionner les notes, Naviguer dans l’enregistrement seront impliquées. Tout à bord, lors de la séance, outre enregistrer toute la séance, les collaborateurs en présence peuvent prendre des notes dans l’Espace Notes au moment où ils abordent des points clés. Les notes peuvent être écrites à la main ou transcrites à travers des messages vocaux enregistrés par les collaborateurs. À la fin de la séance, en cliquant sur la fonction Sélectionner les notes se trouvant dans le menu principal, chaque note peut être sélectionnée en cochant une petite icône apparue à côté. Une fois les notes cibles sélectionnées, tout en bas de l’Espace Notes, on peut trouver un bouton appelé Production Résumé. En cliquant sur ce bouton, un résumé sera produit automatiquement. Pour récupérer les informations de la séance passée, la collaboratrice absente a à sa disposition deux ressources : le résumé susmentionné et l’enregistrement vidéo de la séance. En lisant le résumé, elle peut identifier des points clés abordés pendant la séance. Si elle sélectionne la fonction Naviguer dans l’enregistrement, en haut à droite de l’enregistrement, une barre de recherche apparaît où elle peut insérer des mots ou phrases clés pour repérer dans l’enregistrement vidéo les parties importantes pour elle. Ainsi au lieu de regarder tout l’enregistrement qui normalement peut durer très longtemps, elle peut naviguer dans la data complète de manière plus efficace. Si la collaboratrice porte les lunettes, à travers l’imagerie 3D de l’objet cible affichée dans l’enregistrement, les lunettes vont aussi imager l’objet virtuellement dans l’espace pour une vision stéréoscopique.

Prendre notes dans l'espace notes

Sélectionner les notes pour produire le résumé

Repérer les parties clefs et naviguer dans l’enregistrement

Scénario 3

Un projet a été terminé et toutes les données ont été enregistrées. Des chercheurs qui s'intéressent au projet voudraient faire de la recherche centrée sur le processus de la production. Ils demandent à l’équipe des informations.

En se basant sur toutes les données enregistrées (les notes, enregistrement) et des fonctions telles que la recherche, le repérage, le montage etc, l’outil permet à l’équipe de produire des tutoriels qui seront accessibles sur la demande.

Plus-value et évaluation

Plus-value

Dans des logiciels largement répandus comme Zoom, depuis la pandémie, nous nous rendons compte que ses outils ne permettent pas un travail optimal entre des collaborateurs du FacLab qui communique à distance avec d’autres membres. Ainsi, nous avons pensé à CatchUp. CatchUp est ici pour répondre à divers besoins :

- Il permet à un groupe travaillant sur un projet de manipuler un item malgré la distance qui les sépare. Le but est de reproduire une retranscription la plus fidèle de l’item aux personnes qui ne sont pas présentes au FacLab afin de garantir l’authenticité de l’expérience, de manière synchrone.

- À cela s’ajoute la communication vocale entre les participants, mais surtout la possibilité d’en garder les traces et de les mettre en évidence ! Soit par recherche intelligente de mots à l’oral, soit par les commentaires que les collaborateurs auront décidés de mettre en évidence.

- Nous ajoutons également une aide-externe, une intelligence artificielle afin de simplifier les processus pour les collaborateurs.

- Les collaborateurs asynchrones peuvent également revisionner les séances. qui seront enregistrées sur un serveur local au FacLab, ce qui ira à la fois alimenter l’IA et garder une trace pour les utilisateurs.

- L’aspect le plus fort de notre outil repose donc sur l’interactivité avec les items, malgré la distance. De plus, il y a la possibilité de garder des traces et de les marquer pour tout autre collaborateur qui n’a pas pu être présent lors de la réunion, voire même pour un simple rappel pour les utilisateurs.

Evaluation

Grâce à des retours utilisateurs, il est possible de prendre en compte l’expérience utilisateur afin d’appliquer des améliorations futures. Pour ce faire, il y a deux manières de faire avec notre programme :

1-Evaluation de l’application : Comme tout application ou logiciel, on donne la possibilité aux utilisateurs de noter CatchUp sur 5 étoiles avec, en parallèle, la possibilité d’accompagner sa note avec un commentaire. Ces feedbacks seront nécessaires pour toujours mieux adapter le programme.

2- Evaluation des appels : Tout comme il peut parfois arriver à la fin d’une discussion WhatsApp, Discord ou même Skype, on peut introduire l’apparition d’un message à la fin d’une séance pour demander à l’utilisateur, s’il le souhaite, de noter son appel et de partager les soucis qu’il aurait pu rencontrer avec le logiciel durant l’appel.

Limites

- Le logiciel n’a pas de tutoriel : l’utilisateur pourrait passer à côté de certaines fonctions / outils disponibles.

- Le matériel nécessaire est assez conséquent et coûteux : les lunettes et les gants réunissant ces technologies ne sont pas facilement accessibles, en revanche, nous supposons qu'ils le seront comme toute technologie nouvelle, notant l'exemple de l'accessibilité de l'ordinateur jadis et son accessibilité aujourd'hui.

- Dépendant de la connexion Internet.

- Comme tout est encore théorique, nous ignorons si nos mesures seront adaptées et adoptées par les utilisateurs.

- Les séances enregistrées ne retranscrivent pas l’expérience-utilisateur de la manipulation de l’objet avec les lunettes et les gants vu que nous n'avons pas encore une idée réelle sur le comment de cette retranscription.

Futures évolutions

En prenant en compte les limites, il y a plusieurs éléments qu’il est possible d’améliorer, avec le temps :

- Insérer un tutoriel d’initiation au programme, afin de présenter son fonctionnement et les différents outils qu’il met à la disposition des utilisateurs.

- Permettre l’enregistrement d’une séance dans les fichiers locaux (par exemple, si l'utilisateur a un problème de connexion Internet, qu’il puisse tout de même garder une trace et l'envoyer à d’autres personnes).

- Adapter et améliorer le logiciel pour une meilleure expérience utilisateur en fonction des retours et des tests des utilisateurs.

- Insérer la retranscription visuelle et sensorielle aux enregistrements afin que ceux qui visionnent les séances, de manière asynchrones, puissent se mettre pleinement dans le contexte.

Bibliographie

Bastien, J.M.C. et Scapin, D.L. (1993). Critères ergonomiques pour l’évaluation d’interfaces utilisateurs. Rapport technique INRIA n° 156, Juin 1993, INRIA : Le Chesnay.

Butz, A., Hollerer, T., Feiner, S., MacIntyre, B., and Beshers, C. (1999). Enveloping users and computers in a collaborative 3d augmented reality. In International Workshop on Augmented Reality (IWAR),54–62.

Cosnefroy, L. (2010). L’apprentissage autorégulé: Perspectives en formation d’adultes. Savoirs, 23(2), 9-50. https://doi.org/10.3917/savo.023.0009

Greenberg, S., Gutwin, C., and Cockburn, A. (1996). Awareness through fisheye views in relaxed-wysiwis groupware. InProceedings of Graphics Interface, 28–38.

George, S., Michel, C., & Ollagnier-Beldame, M. (2013). Usages réflexifs des traces dans les environnements informatiques pour l’apprentissage humain. Intellectica, 59(1), 205-241.

Leroux, Monteil, J.-M., & Huguet, P. (2017). Apprentissages scolaires et technologies numériques : Une revue critique des méta-analyses. L’année Psychologique, 117(4), 433–465. https://doi.org/10.4074/S0003503317004018

Lou, Y., Abrami, P. C., & d’Apollonia, S. (2001). Small Group and Individual Learning with Technology: A Meta-Analysis. Review of Educational Research, 71(3), 449–521. https://doi.org/10.3102/00346543071003449

Mayer, R.E. (2010). Apprentissage et technologie. In H. Dumont, D. Istance & F. Benavides (Eds). Comment apprend-on ? : La recherche au service de la pratique (pp. 191-209). Éditions OCDE.

Mohib, N. (2018). Stratégies d’autorégulation et synchronisation des temporalités dans un dispositif hybride : le rôle de l’évaluation. Distances et médiations des savoirs, 22.

Molinari, G. (2021). (MA75314 Apprentissage digital et formation à distance) [Présentations Moodle]. Genève : Université de Genève. Repéré sur la plateforme Moodle.

Nassima Ouramdane.(2009) Vers un système d’assistance à l’interaction 3D pour le travail et le télétravail collaboratif dans les environnements de Réalité Virtuelle et Augmentée. Interface homme-machine [cs.HC]. Université d’Evry-Val d’Essonne, 2008. Français. NNT : . tel-00374961

Simonian, S., Quintin, J. & Urbanski, S. (2016). La construction des collectifs dans l’apprentissage collaboratif à distance : l’affordance socioculturelle des objets numériques. Les Sciences de l'éducation - Pour l'Ère nouvelle, 49, 63-90. https://doi.org/10.3917/lsdle.491.0063

Tchounikine, P., & Tricot, A. (2011). Environnements informatiques et apprentissages humains. In C. Garbay & D. Kayser (Eds.), Informatique et Sciences Cognitives : influences ou confluences ? (pp. 167-200). Ophrys/MSH.